人工神经网络

一个最重要的创新:人工神经网络

1

为什么需要神经网络?

简单来讲,神经网络意味着理论上它可以学习任何用户动作的映射!

为了介绍一会儿将使用的一些术语,从状态到行动的映射将被称为“策略”。

为了让拳手的神经网络学习策略,AI Arena将采取模拟学习和强化学习。其中神经网络架构存储在IPFS上。

2

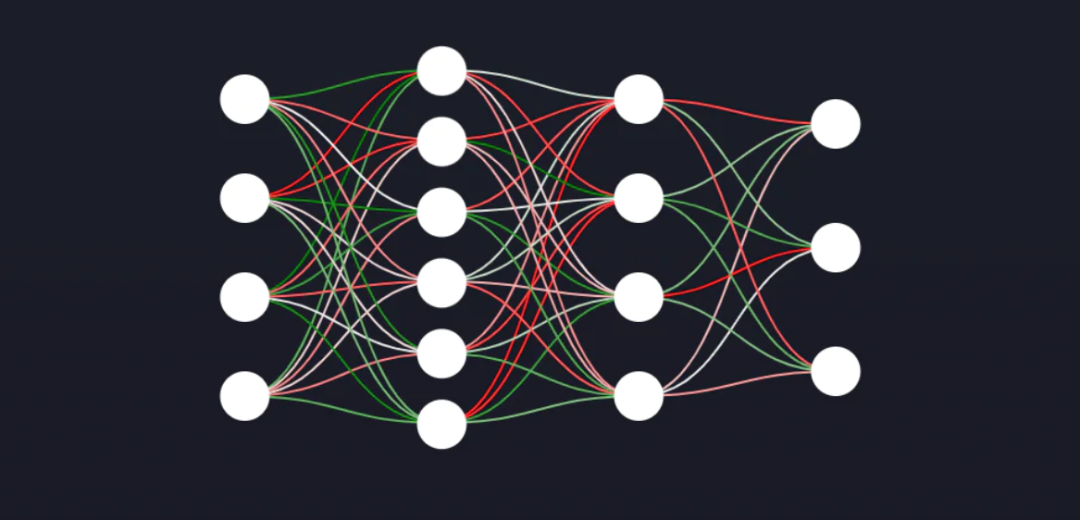

权值

在上图中,神经元之间的连接称为“权值”。当你的神经网络正在“学习”时,所发生的是它正在改变权值的值。

权值最终将决定状态如何映射到动作,这意味着我们可以将权值解释为“智能”。

神经网络权值对于每个NFT都是唯一的,并存储在以太坊上。

AI设计机制全攻略

状态

(1)什么是状态?

状态是环境在某个时间点的表示。它并没有包含所有信息——只包含了其中必要的信息。

例如:研究人员使用屏幕上的所有像素作为状态,让AI计算出像素代表什么。然后根据他们认为对决策过程重要的因素进行人工调试。

AI Arena一再强调其关心的是为所有人提供平等的机会——团队希望奖励能够更多地给予坚持训练AI的用户,而不是奖励拥有更多资源的用户。

(2)游戏将使用哪些变量?

下面是状态中包含的变量列表。需要注意的是,AI Arena将使用下标1表示用户自己的AI,下标2表示对手。

此外,竞技场的左边界的X位置为0,右边界的X位置为1。

训练

(1)训练概述

这是改变神经网络中权值的过程,以使AI能够起作用。

例如:如果我们在对手面前,我们可能希望我们的战士出击。

有一系列的权值可以实现这一点,训练的重点是让AI学会在特定场景中采取特定的行动。

AI Arena在应用程序中嵌入了以下培训计划:

模仿学习

为了学习如何战斗,你的AI将观察你并学习模仿你的动作。

自我学习

为了学习你无法教给它的技能,你的AI将与自己的副本对抗,以不断提高。

(2)为什么需要训练?

1·随机初始化

首次创建NFT拳手时,神经网络权值也随之生成。一开始它会随机采取行动,因为它不知道在什么情况下应该采取什么行动。

因此为了准备战斗,我们必须训练它,使它学会一个好的作战策略。

2·随机策略

正如上文“神经网络”部分中提到的,从状态到动作的映射称为策略。

换句话说,策略定义了代理在某些情况下的行为方式。在训练之前,NFT拳手还没有学会一个好的战斗策略,所以只是随机行动。

模仿学习

(1)通过观察学习

理解模仿学习的最好方法是想象你是一个师父,你的AI是一个你正在准备战斗的战士。

你用你的人工智能进行搏击,它学习模仿你在特定场景中的动作。

我们正在写一篇关于模仿学习的综合博文,到时候会将其链接到这里。

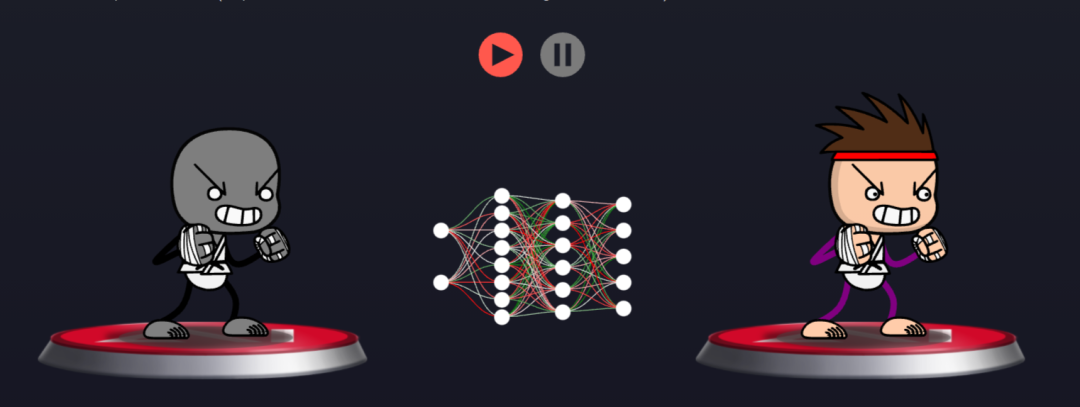

(2)演示

实际情况:你实际操控的是左边的灰色拳手,而你的AI在右边。你可以测试一些动作,观察AI如何模仿你。

请注意:它不会立即复刻你的动作,因为神经网络需要一点时间来学习,所以在AI学会之前,你可能需要多重复几次你的动作。

为简单演示,目前AI Arena只允许用户使用这些操作:向左跑、向右跑、单拳、双拳和防守。

测试链接:

//docs.aiarena.io/#/training/imitation-learning

自我学习

(1)完美匹配

最完美的拳击搭档就是用户自己。通过自我学习,你的AI总是在不断地挑战自己,不断地改进。

(2)不同的学习范式

通过模仿学习,AI通过观看演示进行学习。在自我学习中,AI像对手一样学习和战斗没有多大意义,因为对手是人工智能本身的克隆。

但是如果没有专家向人AI展示如何战斗,那么它如何学习该做什么呢?——通过奖励。

AI将学会采取给予它更多正向奖励的行动,而减少采取给予它负面奖励的行动。

定制训练

Python环境【正在准备中】

AI Arena计划为玩家引入一个python环境来训练他们自己的模型。

目前,用户仅限于使用团队在应用程序中提供的两种培训方法;但不久的将来,应用程序将可以允许玩家导入其自定义培训模型并上链。

游戏模式探索

战斗

AI Arena目前有两种可用的作战模式:模拟赛和排位赛。除此之外,团队计划在不久后整合另外两种作战模式。

1)模拟赛

玩家可以在对抗竞技场测试他们的拳手来预先训练的AI。在这种模式下将没有任何奖励。

2)排位赛

玩家将让他们的拳手去对抗来自世界各地的拳手。玩家的唯一目标就是努力攀登排行榜,成为竞技场的冠军!

玩家在排行榜上的排名越高,赢得一场战斗的回报奖励就越高。

3)目标

虽然每种战斗模式都有其独特之处,但它们都有一个共同的胜利目标:在指定的时间内消耗对手所有生命值。

链金交易员总结

目前AI Arena尚处在早期,很适合提前埋伏观察。据官方透露,游戏正式版本大概率于明年推出,而今年年末推出的测试版本将只有白名单用户可以参与体验。

白名单用户名额的获取方式是参与团队即将推出的解密游戏,通过游戏后的用户将会被随机选择是否进入白名单。

有兴趣的玩家可以加入他们的Discord尝试体验,大概率后期会有早鸟空投奖励。

相关链接:

官网:

https://aiarena.io/#/

Twitter:

https://twitter.com/aiarena_crypto

Discord:

https://discord.com/invite/aiarena